우버와 테슬라 자동차의 안타까운 사고

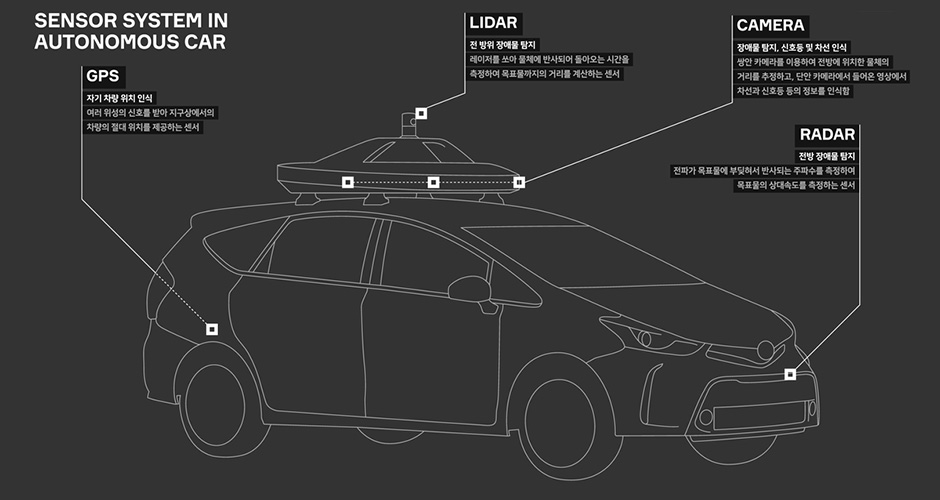

자율주행차에는 소형 사이즈의 초음파 센서부터 영상, 레이더, 라이다 등 다양한 센서들이 운전자의 시각적 인지력을 지원하거나 대신하고 있다. 운전자는 주행할 때 시야가 흐리거나, 예기치 못한 돌발적인 전방상황에 대해 컴퓨터처럼 0 또는 1로 판단할 수 없다. 경험에 따른 주행상황을 확률적으로 예측하거나, 교육되지 않은 주행상황에 대해서는 종합적 판단력으로 안전하게 대응할 뿐이다. 최근 자율주행기술이 일부 상용화되고 생활 가까이에서 자율주행 서비스가 제공되고 있다. 하지만 센서 오작동을 비롯한 센서 성능의 한계로 인한 안전사고가 발생하면서 자율주행에 대한 불안감이 가중되고 있다.

2018년 3월, 자율주행 택시 서비스를 제공하고 있는 우버는 자율주행모드에서 자전거를 끌고 도로를 횡단하는 보행자를 인지하지 못하는 상황이 발생되었다. 낮은 조도의 도로에서 주간용 영상센서 대신 레이더 또는 라이다 센서가 장애물을 검출해야 할 상황이었지만, 속도를 줄이는 등의 대응이 발견되지 않았다. 횡단보도가 없는 구간으로 정밀 맵의 도움도 받을 수 없는 상황이었다. 테슬라 차량 역시 자율주행모드에서 중앙 분리대를 발견하지 못하여 운전자 사망 사고로 이어졌다. 자동차업계에서는 개별 센서의 성능 한계를 우려해서 다양한 센서를 융합하여 기능을 상호 보완적으로 활용한다. 그러나 차량이라는 제한된 전력과 처리능력 한계로 인해 무한의 센서를 융합할 수 없는 상황이다. 따라서 최소 개수의 센서를 이용하여 최대의 안전성을 지키기 위한 노력이 지속되어야 한다.

자동차에 달린 수많은 센서가 주변 상황을 파악하고 안전운전을 돕는다 (출처: 네이버 랩스)

레이더 센서

레이더 센서는 전자기파를 송출하여 물체에 부딪쳐서 반사하는 신호를 해석, 목표물의 거리와 각도, 속도 등의 정보를 만들어낸다. 관측 레이더와 기상 레이더, 3차원 레이더 등 다양한 레이더가 존재하지만, 국내의 기술개발은 해외 의존적이고, 특히 칩벤더의 솔루션에 기대고 있는 실정이다. 현재는 인피니언사나 프리스케일사(현재 NxP) 그리고 TI 등에서 칩 솔루션을 제공하고 있다. 국내에서도 자동차 제조사의 1차 벤더를 중심으로 국산화 시도를 하고 있다. 레이더 센서는 단일칩으로 집약되기 이전에는 많은 부품들의 조합을 통해 안테나 설계부터 신호를 송신하고 수신하는 전처리 모듈(FEM:Front End Module), 전처리 모듈을 제어하여 송신 및 수신된 신호를 기반으로 목표물을 검출하고 목표물로부터 다양한 정보를 찾아내는 후처리 모듈(BEM: Back End Module)로 구성하며 대부분의 신호처리 알고리즘은 후처리 모듈에서 이루어지도록 제작되고 있다.

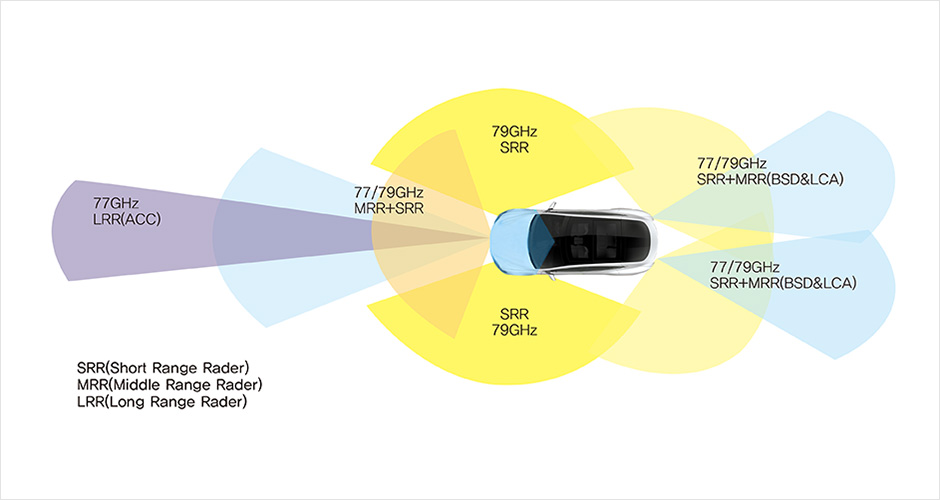

레이더의 주파수 대역은 국제 표준화를 통해 공통으로 대응하고 있으며 다년간 상용화된 24Ghz 밴드에서 현재는 77GHz 전방영역과 76~81GHz의 광대역 영역을 사용하도록 명시되어 있다. 24GHz 영역에서 주파수가 높아진다면 안테나나 모듈의 사이즈를 줄일 수 있고, 사용할 수 있는 대역폭을 넓힐 경우 거리 분해도를 높일 수 있는 장점이 있다. 전 세계 칩밴더들을 중심으로 77GHz의 전방 중거리 레이더(MRR;Mid Range Radar)와 장거리 레이더(LRR;Long Range Radar)를 개발해 상용화하고 있고, 79GHz의 중심주파수를 가진 광대역 밀리미터파 레이더의 경우 작게는 90°에서 150°를 탐지하는 형태의 단거리 레이더(SRR;Short Range Radar)를 개발하고 있다.

자율주행 자동차에서 레이더 센서는 빛의 반사와 터널, 일출·일몰 등의 환경적인 조건에서 카메라보다 유연하며, 안개 상황이나 눈·비 등의 기후적인 영향에서도 카메라보다 효과적이라 대부분의 자동차업체에서 추진하는 자율주행기술에서 전·후방은 LRR/MRR을 활용하고, 전방 좌우 SRR, 후방 좌우 SRR을 장착하여 최소 6개의 레이더를 활용하는 추세다. 하지만 응용에 따라 다양하게 장착하고 서비스할 수 있도록 설계되고 있다.

레이더 센서는 환경적인 조건에서 카메라보다 유연하고 효과적이다

레이더 센서는 단일칩을 기반으로 모듈이 제작되어, 라이다 센서에 비해 저가의 비용이 들어 1차 벤더나 2차 벤더에서 많은 연구개발 시도를 하고 있다. 다만 저가의 레이더 센서가 목표물 탐지를 위주로 개발되어 목표물이 사람인지, 차량인지, 트럭인지 구분하는 데는 어려움이 있다. 이에 대한 해결책으로 카메라와의 융합을 통해 카메라의 오탐지를 줄이고 악천후에서도 인식 능력을 높이는 형태로 사용되고 있다.

라이다 센서

라이다 센서는 광신호를 일정한 방식으로 조사한 후 장애물 등에서 반사되어 되돌아오는 광 에너지를 분석하여 차량 주변의 3차원 공간정보를 획득하는 장치로서 전통적인 차량용 센서인 비전 센서 및 레이더 센서와 함께 자율주행을 지원하는 핵심 센서다. 특히 최근 라이다 센서를 탑재하지 않고 비전 센서로만 부분적인 자율주행인 오토파일럿을 지원하는 테슬라의 두 번째 인명사고와 라이다 센서를 탑재했지만 바로 앞의 야간 보행자를 검출하지 못한 우버의 첫번째 보행자 인명사고 이후 우수한 3차원 공간분해능력을 제공할 수 있는 라이다 센서의 중요성이 더욱 부각되고 있다.

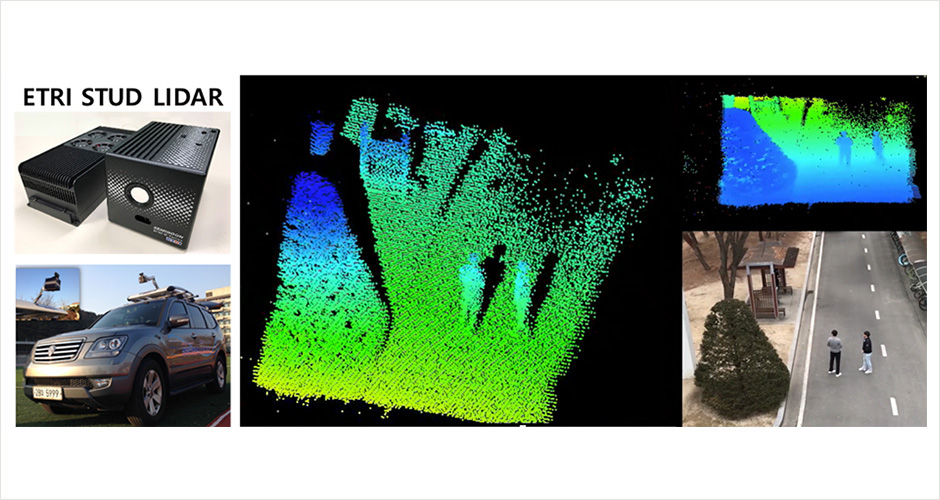

수직해상도 240 픽셀의 고분해능 라이다 3차원 영상샘플 (출처: ETRI)

최대 안정성과 최소 사고율을 확보하기 위해 현재 차량 내 다양한 센서들을 데이터 수준에서 융합하려는 노력이 진행 중이다. 그중 라이다 센서는 기술 자체에서 해상도 및 탐지성능을 최대한 높이는 방향으로 기술혁신이 진행되고 있다.

기존 라이다 기술은 주로 집적화 및 저가격에 유리한 실리콘 광 검출기를 활용하는 905nm 파장대역을 중심으로 발전해왔다. 라이다 구현 방식에 있어서도 비록 해상도는 낮지만 저가격화에 유리한 회전형 라이다가 주요 트렌드였다. 하지만 2018년 CES 전시회를 기점으로 벨로다인(Velodyne) 사는 회전형 방식 제품에서도 수직해상도를 더욱 높여 128픽셀 제품을 출시하였고 다른 방식을 채택한 라이다 회사들도 수직해상도를 50픽셀 또는 그 이상 수준의 고해상도 라이다 기술을 공격적으로 발표하고 있다. 또 다른 핵심적인 변화는 레이저 응용파장에 대한 트렌드 변화로 기존 905nm 파장대역의 한계를 극복할 수 있는 1.5μm 파장의 시각안전 라이다 기술에 대한 재평가와 본격적인 투자가 이루어지고 있다는 점이다. 이 분야는 2012년 한국전자통신연구원(ETRI)에서 세계 최초 연구 프로토타입으로 발표한 바가 있다. 작년 3600만 달러(약 387억6480만 원) 투자를 받은 루미널 테크놀로지(Luminar Technologies)사가 언론에 공개되면서 이 분야의 투자를 선도해가고 있다. 기존 905nm 파장대역에 기반 한 라이다는 실제 도로를 활용한 필드테스트에서 비와 안개 등 일부 특정 상황에서 성능의 한계점이 드러나고 있다. 또 최근 발생한 인명사고 등으로 인하여 이러한 변화 추세가 더욱 빨라지고 있다. 아직까지 국내 기업은 주로 회전형 기반의 낮은 해상도의 라이다 기술에 집중하고 있는 데 반해 전 세계 라이다 시장은 이미 고해상도, 고성능 라이다 기술로 빠르게 변화하고 있다.

- 최정단

- ETRI 자율주행시스템연구그룹 책임연구원

- 박미룡

- ETRI 스마트이동체연구실 책임연구원

- 민봉기

- ETRI 광융합부품연구그룹 책임연구원